Selbstversuch: Wie leicht ein Fake‑Account auf Facebook entsteht – und warum das System trotzdem versagt

Auf Facebook tummeln sich jede Menge Fake‑Accounts. Ich frage mich das schon lange: Wie kann das eigentlich sein? Schließlich beteuert der Konzern regelmäßig, mit enormem technischem Aufwand gegen gefälschte Profile vorzugehen.

Also habe ich mich zu einem Selbstversuch entschlossen.

Der Selbstversuch: Ein Fake‑Profil in wenigen Minuten

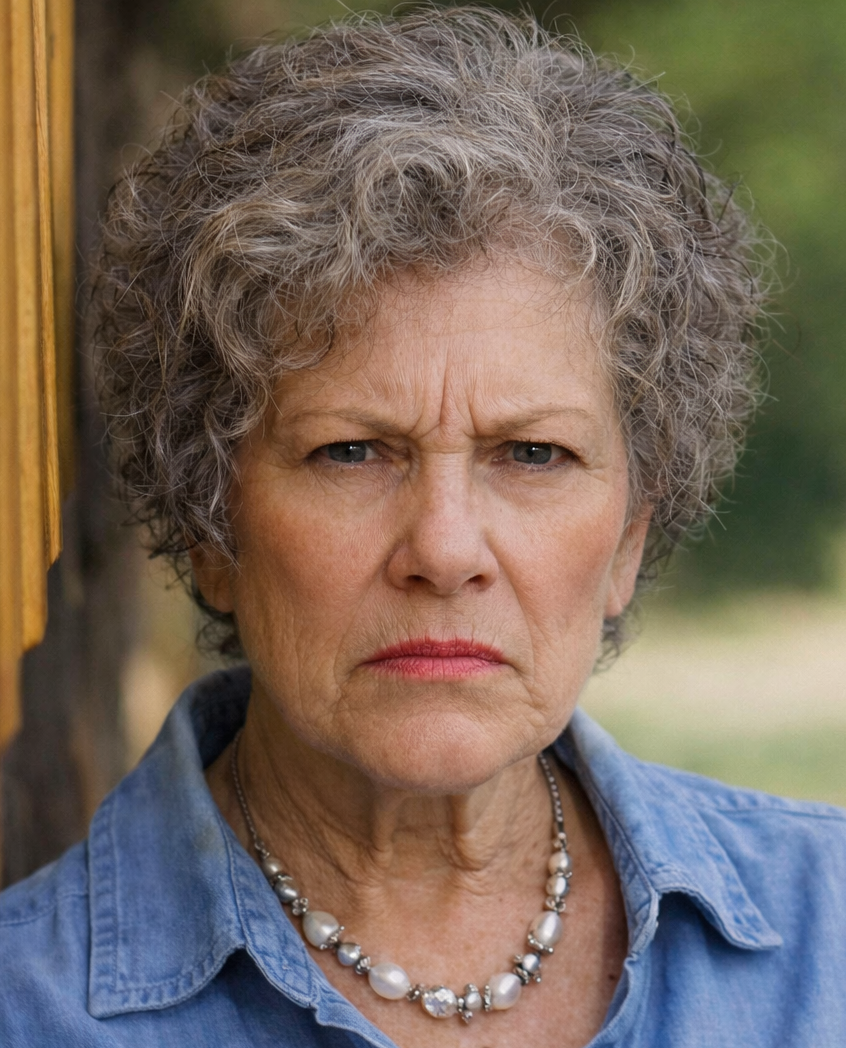

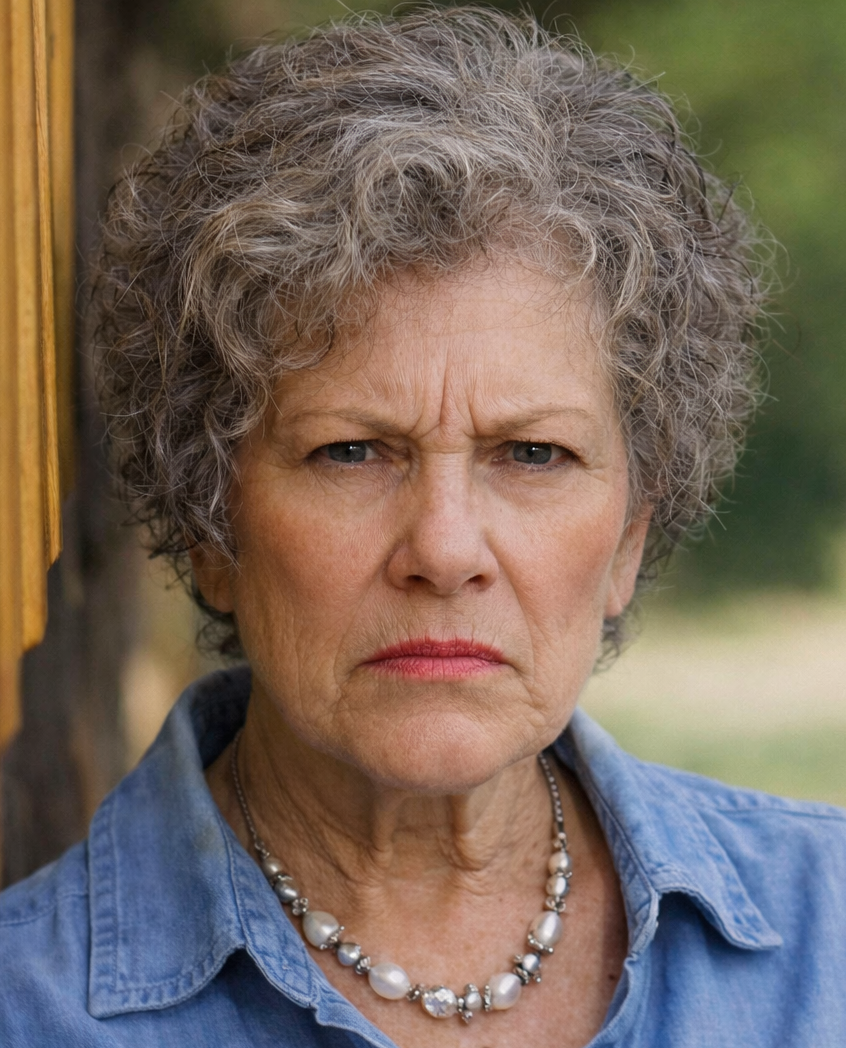

Ich legte einen Facebook‑Account unter dem frei erfundenen Namen Maria Schneider an. Dazu ließ ich mir ein fotorealistisches KI‑Portrait und ein passendes KI‑Titelbild erzeugen. Keine echten Fotos, keine reale Person.

Ich legte einen Facebook‑Account unter dem frei erfundenen Namen Maria Schneider an. Dazu ließ ich mir ein fotorealistisches KI‑Portrait und ein passendes KI‑Titelbild erzeugen. Keine echten Fotos, keine reale Person.

Nach der Anmeldung gab ich persönliche, aber vollständig erfundene Daten ein und lud die KI‑Bilder hoch. Bis zu diesem Punkt verlief alles völlig problemlos. Kein Warnhinweis, keine Nachfrage, kein Abgleich.

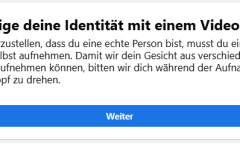

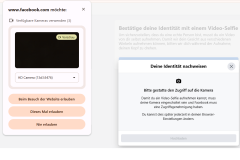

Erst danach verlangte Facebook plötzlich eine Identitätsbestätigung per Video‑Selfie.

Ich spielte den Prozess bewusst nur bis zur eigentlichen Aufnahme durch – und brach ihn dann ab.

Die Reaktion von Facebook

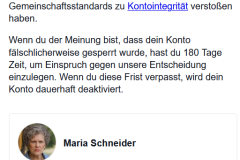

Nur wenige Minuten später kam die E‑Mail:

Dein Konto wurde gesperrt. Du hast 180 Tage Zeit, Einspruch einzulegen.

Der Fake‑Account war also erkannt – allerdings erst nachträglich.

Die zentrale Frage

Wenn Facebook bei neuen Konten ein Video‑Ident verlangt und Profile bei Nicht‑Durchführung sofort sperrt, wie können dann trotzdem so viele Fake‑Accounts existieren?

Diese Frage ist alles andere als trivial.

Warum Fake‑Accounts trotzdem möglich sind

1. Keine verpflichtende Identitätsprüfung bei der Anmeldung

Facebook verlangt bei der Registrierung keinen amtlichen Identitätsnachweis. Name, Geburtsdatum, Fotos – alles kann frei gewählt werden. Die Video‑Selfie‑Prüfung greift nur in bestimmten Situationen, etwa bei Auffälligkeiten oder automatischen Risikobewertungen.

Quelle: https://about.fb.com/news/2019/05/fake-accounts/

2. Automatisierte Systeme erkennen nicht alles sofort

Meta setzt auf KI‑gestützte Erkennungssysteme, die verdächtige Muster analysieren. Neue Konten, die sich zunächst passiv verhalten, können diese Prüfungen oft unauffällig passieren.

Quelle: https://transparency.fb.com/enforcement/spam-and-fake-accounts/

3. KI‑Bilder machen Fake‑Profile glaubwürdiger

KI‑generierte Gesichter wirken heute täuschend echt. Sie tauchen in keiner Rückwärtssuche auf und zeigen keine typischen Bearbeitungsspuren. Für automatisierte Systeme sind sie schwer von echten Fotos zu unterscheiden.

KI‑generierte Gesichter wirken heute täuschend echt. Sie tauchen in keiner Rückwärtssuche auf und zeigen keine typischen Bearbeitungsspuren. Für automatisierte Systeme sind sie schwer von echten Fotos zu unterscheiden.

4. Massenhafte Erstellung aus dem Ausland

Viele Fake‑Accounts entstehen nicht einzeln, sondern automatisiert in großer Zahl – etwa für Desinformation, Betrug oder Reichweitenmanipulation. Selbst wenn Facebook Millionen solcher Konten löscht, bleiben ständig neue aktiv.

Quelle: https://www.europarl.europa.eu/thinktank/de/document/EPRS_BRI(2020)649367

Fake‑Accounts Facebook. Mein Fazit

Mein Selbstversuch zeigt: Facebook kann Fake‑Accounts erkennen – aber oft zu spät. Die Identitätsprüfung per Video‑Selfie wirkt eher wie ein Notbrems‑System als wie eine echte Eingangskontrolle.

Solange keine verbindliche Identitätsprüfung bei der Anmeldung existiert, werden Fake‑Accounts weiterhin entstehen. KI hilft beim Erkennen, KI hilft aber genauso beim Täuschen.

Fake‑Accounts Facebook. Für uns Nutzer bedeutet das vor allem eines: kritisch bleiben. Nicht jede freundliche Anfrage stammt von einer echten Person.